Google на конференции Cloud Next анонсировал Ironwood — новый специализированный чип для искусственного интеллекта. Это седьмое поколение TPU от Google и первый, оптимизированный для выполнения вычислений уже обученных моделей (инференса). Ironwood будет применяться в Google Cloud, предлагая две конфигурации: серверы с 256 чипами и кластеры, включающие 9216 чипов.

Рынок проприетарных ИИ-ускорителей, где лидирует Nvidia, становится все более конкурентным. Объявление о Ironwood происходит на фоне активного продвижения собственных решений другими гигантами. Amazon, например, использует в AWS процессоры Trainium, Inferentia и Graviton, а Microsoft внедряет чипы Cobalt 100 в своих облачных сервисах Azure.

Google заявляет, что Ironwood обладает пиковой вычислительной производительностью 4614 Тфлопс или 4614 триллионов операций в секунду. Так, кластер из 9216 таких чипов предложит производительность в 42,5 Экзафлопс.

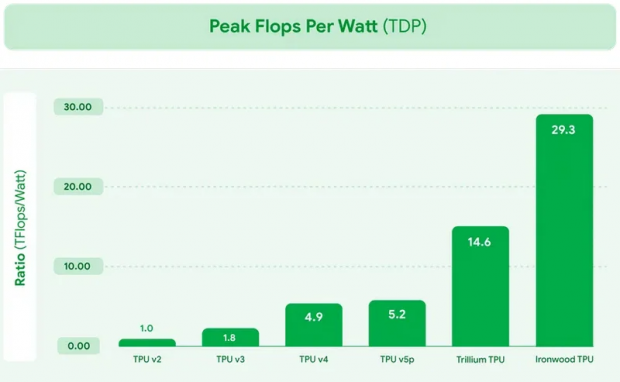

Сердцем нового модульного вычислительного кластера Google Cloud, AI Hypercomputer, станет процессор Ironwood. Каждый процессор Ironwood оборудован 192 ГБ высокоскоростной оперативной памяти (7,4 Тбит/с) и специализированным ядром SparseCore, оптимизированным для обработки разреженных данных, характерных для задач расширенного ранжирования и рекомендательных систем (например, персонализированных предложений одежды). Архитектура TPU Ironwood минимизирует перемещение данных и задержки, обеспечивая, по заявлению Google, существенную энергоэффективность.

Горячие темы