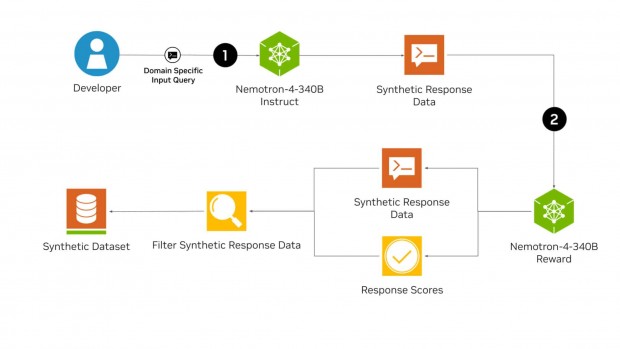

Nvidia представила Nemotron-4 340B — передовое семейство открытых моделей, которые преобразуют генерацию данных для обучения крупных языковых моделей (LLM).

Модель, обученная на 9 триллионах токенов, поддерживает контекстное окно в 4000 символов и работает с более чем 50 естественными языками и 40 языками программирования. Nemotron-4 340B превосходит своих конкурентов, таких как Mistral’s Mixtral-8x22B, Anthropic’s Claude-Sonnet, Meta’s Llama3-70B, Qwen-2.

Одна из наиболее заметных особенностей Nemotron-4 340B — это лицензия, пригодная для коммерческого использования.

Горячие темы